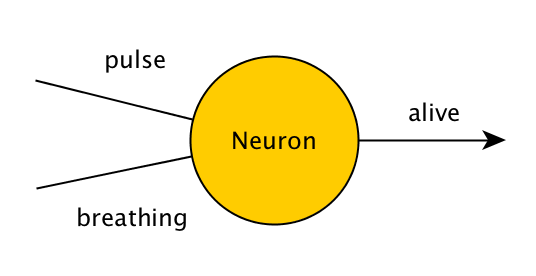

Sieć neuronowa (zwana również ANN lub sztuczną siecią neuronową) to rodzaj oprogramowania komputerowego, inspirowanego biologicznymi neuronami. Biologiczne mózgi są zdolne do rozwiązywania trudnych problemów, ale każdy neuron jest odpowiedzialny tylko za rozwiązanie bardzo małej części problemu. Podobnie, sieć neuronowa składa się z komórek, które współpracują ze sobą, aby uzyskać pożądany rezultat, chociaż każda pojedyncza komórka jest odpowiedzialna tylko za rozwiązanie niewielkiej części problemu. Jest to jedna z metod tworzenia sztucznie inteligentnych programów.

Sieci neuronowe są przykładem uczenia maszynowego, w którym program może się zmieniać w miarę uczenia się, aby rozwiązać problem. Sieć neuronowa może być trenowana i ulepszana z każdym przykładem, ale im większa sieć neuronowa, tym więcej przykładów potrzebuje, aby działać dobrze, często potrzebując milionów lub miliardów przykładów w przypadku głębokiego uczenia.

Jak to działa w praktyce?

W najprostszym ujęciu sieć neuronowa przetwarza dane w kilku krokach:

- Wejście: Sieć otrzymuje dane (np. obraz, tekst, sygnał audio).

- Propagacja w przód: Dane przechodzą przez kolejne warstwy „neuronów”, które wykonują proste obliczenia (sumowanie ważone + funkcja aktywacji), a wynik przechodzi do następnej warstwy.

- Porównanie z oczekiwaną odpowiedzią: Na wyjściu obliczana jest różnica między przewidywaniem a poprawną wartością, określana przez funkcję kosztu (loss).

- Uaktualnienie wag: Błąd rozprowadzany jest wstecz (algorytm backpropagation), a wagi synaptyczne są modyfikowane przy użyciu metody optymalizacji (np. gradientu prostego, Adam), aby zmniejszyć błąd.

- Powtarzanie: Proces powtarza się wielokrotnie na dużej liczbie przykładów — dzięki temu sieć „uczy się” rozpoznawać wzorce.

Architektura i podstawowe elementy

- Neuron (perceptron): Element obliczeniowy, który sumuje wejścia pomnożone przez wagi i stosuje funkcję aktywacji (np. ReLU, sigmoid, tanh).

- Warstwy: Wejściowa, ukryte (jedna lub wiele) i wyjściowa. Głębokie sieci mają wiele warstw ukrytych — stąd pojęcie deep learning.

- Wagi i biasy: Parametry sieci, które są uczone podczas treningu.

- Funkcja kosztu: Miara błędu (np. MSE dla regresji, cross-entropy dla klasyfikacji).

- Algorytm optymalizacji: Sposób aktualizacji wag (np. SGD, Adam).

Typy sieci neuronowych

- Sieci jednokierunkowe (Feedforward): Najprostszy typ, typowo używany do klasyfikacji i regresji.

- Splotowe sieci neuronowe (CNN): Dobrze sprawdzają się w analizie obrazów i sygnałów — wykorzystują warstwy splotowe do wykrywania lokalnych wzorców.

- Rekurencyjne sieci neuronowe (RNN): Przeznaczone do danych sekwencyjnych (np. tekst, czasowe serie). Ich rozwinięciami są LSTM i GRU, które lepiej radzą sobie z długimi zależnościami.

- Transformery: Architektura oparta na mechanizmie attention, obecnie dominująca w przetwarzaniu języka naturalnego i coraz częściej stosowana w innych dziedzinach.

- Autoenkodery i GAN: Autoenkodery do redukcji wymiarowości i uczenia reprezentacji; GAN (Generative Adversarial Networks) do generowania nowych danych.

Proces uczenia i praktyczne zagadnienia

- Podział danych: Zwykle dzieli się dane na zbiór treningowy, walidacyjny i testowy.

- Hiperparametry: Wielkość sieci, szybkość uczenia (learning rate), rozmiar batcha, liczba epok — ich dobór ma duży wpływ na wynik.

- Regularizacja: Metody zapobiegające nadmiernemu dopasowaniu (overfitting), np. dropout, L2 (weight decay), wczesne zatrzymanie (early stopping).

- Ocena: Metryki takie jak accuracy, precision, recall, F1, AUC pomagają ocenić efektywność modelu, zależnie od zadania.

- Zapotrzebowanie obliczeniowe: Głębokie sieci często wymagają GPU/TPU i dużych zasobów danych, co wpływa na koszty i czas treningu.

Zastosowania

Sieci neuronowe znalazły zastosowanie w wielu dziedzinach. Przykłady:

- Rozpoznawanie obrazów i wideo: Klasyfikacja obiektów, detekcja, segmentacja — np. w systemach nadzoru, medycynie (analiza obrazów radiologicznych).

- Przetwarzanie języka naturalnego (NLP): Tłumaczenia maszynowe, analiza sentymentu, chatboty, generowanie tekstu (np. modele oparte na transformerach).

- Rozpoznawanie mowy i synteza: Automatyczne systemy rozpoznawania mowy, asystenci głosowi, transkrypcja.

- Rekomendacje: Systemy rekomendacyjne w e-commerce i serwisach streamingowych.

- Analiza danych medycznych i diagnostyka: Wykrywanie chorób, prognozowanie przebiegu chorób, analiza genomu.

- Finanse: Prognozowanie rynków, wykrywanie oszustw, scoring kredytowy.

- Robotyka i sterowanie: Uczenie na podstawie danych sensorycznych, planowanie ruchu, autonomiczne pojazdy.

- Sztuka i kreatywność: Generowanie obrazów, muzyki, stylizacji tekstu (np. tworzenie treści, grafiki generowanej przez sieci).

Zalety i ograniczenia

- Zalety: Umiejętność wykrywania złożonych wzorców, elastyczność — mogą uczyć się reprezentacji bez ręcznego projektowania cech, dobra skalowalność przy dużych zbiorach danych.

- Ograniczenia: Potrzeba dużych ilości danych i mocy obliczeniowej, trudność w interpretacji (problemy z wyjaśnialnością), podatność na błędy i uprzedzenia wynikające z danych treningowych.

Praktyczne wskazówki

- Zaczynaj od prostszego modelu i małego zestawu danych, by zrozumieć problem.

- Dokładnie przygotuj i oczyść dane — jakość danych często decyduje o sukcesie.

- Monitoruj metryki na zbiorze walidacyjnym, aby wykryć przeuczenie.

- Używaj transfer learningu, gdy masz niewiele danych — gotowe modele (np. w przypadku obrazów) można dostroić do konkretnego zadania.

- Pamiętaj o etyce: oceniaj możliwe uprzedzenia, prywatność i skutki wdrożeń w rzeczywistym świecie.

Podsumowanie

Sieci neuronowe to potężne narzędzie uczenia maszynowego, które umożliwia rozwiązywanie złożonych zadań w wielu dziedzinach. Kluczem do skutecznego zastosowania jest zrozumienie ich architektury, odpowiednie przygotowanie danych, właściwy dobór hiperparametrów oraz świadomość ograniczeń i konsekwencji etycznych. Wraz z rozwojem technologii (szybsze układy obliczeniowe, nowe architektury, lepsze algorytmy) sieci neuronowe będą nadal rosły w znaczeniu i zakresie zastosowań.