Biologię stojącą za uczeniem się przez wzmocnienie można znaleźć na stronie Warunkowanie operacyjne i Nagroda.

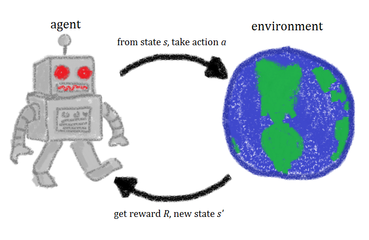

Reinforcement learning (RL) to uczenie agenta oprogramowania, jak ma się zachowywać w danym środowisku, poprzez mówienie mu, jak dobrze to robi. Jest to dziedzina uczenia maszynowego zainspirowana psychologią behawiorystyczną.

Uczenie wzmacniające różni się od uczenia nadzorowanego, ponieważ nigdy nie są pokazywane poprawne dane wejściowe i wyjściowe. Ponadto, uczenie wzmacniające zazwyczaj uczy się w trakcie (uczenie online), w przeciwieństwie do uczenia nadzorowanego. Oznacza to, że agent musi wybrać pomiędzy eksploracją a trzymaniem się tego, co wie najlepiej.

Podstawowe pojęcia

- Agent — podmiot podejmujący decyzje (np. program lub robot).

- Środowisko — wszystko poza agentem: otoczenie, z którego agent otrzymuje obserwacje i nagrody.

- Stan (state) — reprezentacja bieżącej sytuacji środowiska, w której znajduje się agent.

- Akcja (action) — decyzja, którą agent wykonuje w danym stanie.

- Nagroda (reward) — sygnał scalarowy informujący, jak dobra była wykonana akcja; celem agenta jest maksymalizacja skumulowanej nagrody.

- Polityka (policy) — strategia wybierania akcji w zależności od stanu (deterministyczna lub stochastyczna).

- Funkcja wartości (value function) — oczekiwana skumulowana nagroda od danego stanu lub pary stan‑akcja.

- Model — przewidywanie dynamiki środowiska (np. następny stan i nagroda); jeśli istnieje, mówimy o podejściu model‑based.

- Markov Decision Process (MDP) — formalny rachunek problemu uczenia przez wzmacnianie przy założeniu własności Markowa (następny stan zależy tylko od bieżącego stanu i akcji).

- Czynnik dyskontujący (gamma) — określa, jak daleko w przyszłość agent „patrzy”; wartości bliskie 1 oznaczają długoterminowe planowanie.

Jak to działa — główne zasady

- Eksploracja kontra eksploatacja — agent musi balansować między próbowaniem nowych akcji (eksploracja), a wykorzystywaniem znanych już dobrych strategii (eksploatacja). Typowe strategie: epsilon‑greedy, softmax (Boltzmann), Upper Confidence Bound (UCB).

- Uczenie online — agent uczy się podczas działania, na podstawie sekwencji doświadczeń (stany, akcje, nagrody, nowe stany).

- Przypisywanie zasługi (credit assignment) — problem określenia, które wcześniejsze akcje przyczyniły się do uzyskanej nagrody, szczególnie przy opóźnionych nagrodach.

- Sparse rewards — rzadkie nagrody utrudniają naukę; stosuje się techniki typu reward shaping, nagrody pośrednie, lub uczenie hierarchiczne.

- Model‑free vs model‑based — w podejściu model‑free agent uczy się polityki/funkcji wartości bez modelowania dynamiki; model‑based buduje model środowiska i planuje w nim.

Popularne algorytmy

- Q‑learning — klasyczna metoda ucząca funkcję Q(stan,akcja) (model‑free, off‑policy).

- SARSA — podobna do Q‑learning, ale on‑policy (uczy się wartości zgodnie z polityką, którą aktualnie wykonuje).

- Deep Q Network (DQN) — Q‑learning z głęboką siecią neuronową jako aproksymatorem funkcji Q; używa replay buffer i target network dla stabilności.

- Policy gradients (REINFORCE) — bezpośrednia optymalizacja parametrów polityki poprzez gradienty.

- Actor‑Critic — łączy politykę (actor) z oceną wartości (critic) dla lepszej efektywności uczenia.

- PPO, A3C, TRPO — nowoczesne, stabilne algorytmy policy‑based/actor‑critic szeroko stosowane w praktyce.

- Algorytmy hierarchiczne i wielozadaniowe — umożliwiają uczenie złożonych zachowań przez składowanie prostszych podzadań.

Zastosowania

- Gry i symulacje: Atari (DQN), AlphaGo/AlphaZero (kombinacja MCTS i RL).

- Robotyka: uczenie sterowania i manipulacji, adaptacja do nowych warunków.

- Systemy rekomendacyjne i personalizacja: optymalizacja sekwencji sugestii.

- Kontrola procesów przemysłowych i optymalizacja operacji.

- Finanse: modelowanie strategii handlowych, zarządzanie portfelem (uwaga: ryzyko, overfitting).

- Autonomiczne pojazdy i nawigacja.

- Opieka zdrowotna: planowanie terapii i wspomaganie decyzji klinicznych (wciąż wczesne etapy i wysoka wymagana odpowiedzialność).

Wyzwania i ograniczenia

- Wymagania próbne (sample complexity) — wiele algorytmów potrzebuje ogromnej liczby interakcji z środowiskiem.

- Bezpieczeństwo i niezawodność — trudność zapewnienia bezpiecznego działania w nieznanych sytuacjach.

- Reward hacking — agent może znajdować „sztuczki” maksymalizujące nagrodę w sposób niezamierzony przez projektanta.

- Transfer z symulacji do rzeczywistości (sim‑to‑real) — różnice między symulacjami a realnym światem utrudniają wdrożenia.

- Ograniczona interpretowalność — trudność wyjaśnienia, dlaczego agent podejmuje konkretne decyzje.

Narzędzia i biblioteki

- OpenAI Gym — zestaw środowisk do eksperymentów RL.

- Stable Baselines / Stable Baselines3 — implementacje popularnych algorytmów RL.

- RLlib (Ray), Dopamine, keras‑rl — inne frameworki i narzędzia.

- TensorFlow i PyTorch — podstawowe biblioteki do budowy sieci neuronowych wykorzystywanych w deep RL.

Praktyczne wskazówki

- Rozpocznij od prostych środowisk i algorytmów, stopniowo zwiększaj złożoność.

- Używaj replay buffer, target networks i normalizacji wejść, by poprawić stabilność treningu.

- Stosuj odpowiednie strategie eksploracji (np. decay epsilon, Boltzmann) oraz regularizację.

- Monitoruj metryki treningowe, testuj politykę poza trybem treningowym (evaluation episodes).

- Rozważ wykorzystanie symulacji do gromadzenia dużej liczby prób, a następnie technik adaptacji do rzeczywistości (fine‑tuning, domain randomization).

Podsumowując: uczenie przez wzmacnianie to potężne podejście do problemów sekwencyjnego podejmowania decyzji, szczególnie tam, gdzie cel można opisać za pomocą nagród, a bezpośrednich etykiet treningowych brak. Jednocześnie jego skuteczne zastosowanie wymaga przemyślenia kwestii eksploracji, bezpieczeństwa, wydajności próbnej oraz odpowiedniego doboru algorytmów i architektur.