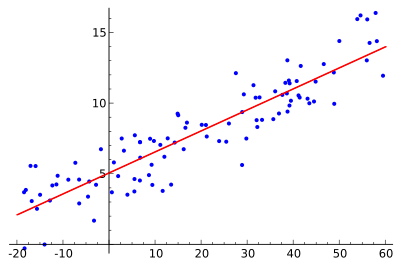

Regresja liniowa jest sposobem na wyjaśnienie zależności między zmienną zależną a jedną lub kilkoma zmiennymi objaśniającymi za pomocą linii prostej. Jest to szczególny przypadek analizy regresji. W najprostszym ujęciu model jednowymiarowy zapisujemy jako y = β0 + β1 x + ε, gdzie β0 i β1 są nieznanymi parametrami, a ε to składnik losowy (błąd). W wersji wielowymiarowej, z p predyktorami, model ma postać y = Xβ + ε, gdzie X to macierz obserwacji, a β wektor współczynników.

Regresja liniowa była pierwszym rodzajem analizy regresji, który był rygorystycznie badany. Wynika to z faktu, że modele, które zależą liniowo od swoich nieznanych parametrów, są łatwiejsze do dopasowania niż modele, które są nieliniowo powiązane z ich parametrami. Co więcej, właściwości statystyczne estymatorów wynikowych są łatwiejsze do określenia — przy pewnych założeniach estymatory mają korzystne własności (np. są nieobciążone i mają najmniejszą wariancję w klasie liniowych estymatorów), co często określa się jako twierdzenie Gaussa–Markowa.

Główne zastosowania

Regresja liniowa ma wiele praktycznych zastosowań. Większość zastosowań należy do jednej z dwóch szerokich kategorii:

- Regresja liniowa może być stosowana w celu dopasowania modelu predykcyjnego do zbioru obserwowanych wartości (danych). Jest to przydatne, jeśli celem jest przewidywanie, prognozowanie lub redukcja. Po opracowaniu takiego modelu, jeśli następnie zostanie podana dodatkowa wartość X bez towarzyszącej jej wartości y, to dopasowany model może być użyty do przewidywania wartości y.

- Biorąc pod uwagę zmienną y oraz szereg zmiennych X1, ..., Xp, które mogą być związane z y, analizę regresji liniowej można zastosować do ilościowego określenia siły związku między y a Xj, do oceny, który Xj nie ma żadnego związku z y, oraz do określenia, które podzbiory Xj zawierają zbędne informacje o y.

Metoda najmniejszych kwadratów (OLS)

Modele regresji liniowej starają się, aby odległość pionowa pomiędzy linią a punktami danych (np. resztami) była jak najmniejsza. Nazywa się to "dopasowaniem linii do danych" (ang. fitting the line to the data). Często modele regresji liniowej starają się minimalizować sumę kwadratów reszt (najmniej kwadratów), ale istnieją inne sposoby dopasowania. OLS polega na znalezieniu β̂, które minimalizuje sumę kwadratów reszt: RSS = Σ(yi − xi'β)². W zapisie macierzowym rozwiązanie OLS przy założeniu braku perfekcyjnej kolinearności to β̂ = (X'X)⁻¹ X'y. Estymator wariancji błędu oblicza się zwykle jako σ̂² = RSS / (n − p), gdzie p to liczba parametrów (wliczając wyraz wolny).

Metoda najmniejszych kwadratów może być również stosowana do dopasowania modeli, które nie są liniowe. Jak przedstawiono powyżej, terminy "najmniej kwadratów" i "model liniowy" są ściśle powiązane, ale nie są one synonimami.

Założenia klasycznego modelu liniowego

Aby uzyskać miarodajne wnioski z modelu liniowego i właściwości estymatorów OLS, zwykle przyjmuje się kilka podstawowych założeń:

- Liniowość w parametrach: model jest liniowy względem współczynników β.

- Eksogenność (brak korelacji błędów z predyktorami): E[ε | X] = 0.

- Brak perfekcyjnej kolinearności: kolumny macierzy X są liniowo niezależne.

- Homoscedastyczność: wariancja błędów jest stała: Var(εi) = σ².

- Brak autokorelacji: błędy są niezależne (szczególnie ważne w szeregach czasowych).

- Normalność błędów (opcjonalne): ε ~ N(0, σ²) — to założenie nie jest potrzebne do własności Gaussa–Markowa, ale umożliwia testowanie hipotez i konstruowanie przedziałów ufności opartych na rozkładzie t i F.

Wnioskowanie statystyczne i diagnostyka

Estymowane współczynniki interpretuje się jako wpływ jednostkowej zmiany predyktora na zmienną zależną przy założeniu stałości pozostałych zmiennych. Do oceny istotności współczynników używa się testów t (dla pojedynczych współczynników) i testu F (dla całego modelu lub podzbiorów parametrów). Jako miary dopasowania stosuje się współczynnik determinacji R² oraz jego wersję skorygowaną (adjusted R²), a także kryteria informacyjne (AIC, BIC) oraz walidację krzyżową.

W praktyce kluczowa jest diagnostyka modelu. Najczęstsze narzędzia to wykresy reszt (residuals vs fitted), histogramy i wykresy normalności reszt, wykresy wpływu obserwacji (leverage), odległość Cooka, analiza wartości VIF (variance inflation factor) do wykrywania multikolinearności oraz testy autokorelacji (np. test Durbin–Watson). Naruszenia założeń mogą prowadzić do niepoprawnych wniosków i wymagają korekt (np. uogólnione estymatory, transformacje, modele z cięższymi ogonami, heteroscedasticity-robust standard errors).

Rozszerzenia i alternatywy

- Regresja grzbietowa (ridge): Obejmuje karę L2 na wielkość współczynników, co zmniejsza wariancję kosztem niewielkiego obciążenia — pomocne przy multikolinearności.

- LASSO: kara L1 prowadząca do kształtuowania zerowych współczynników i selekcji cech.

- Regresja odporna: metody minimalizujące sumę bezwzględnych odchyleń (LAD), estymatory Huber’a i inne techniki odporne na obserwacje odstające.

- Modele nieliniowe: gdy zależność nie jest liniowa względem parametrów, można stosować nieliniowe metody najmniejszych kwadratów lub inne algorytmy dopasowania.

- Modele uogólnione: gdy zmienna zależna nie jest ciągła/normalna — np. regresja logistyczna dla zmiennej binarnej.

Zastosowania praktyczne i przykłady

Regresja liniowa jest powszechnie stosowana w ekonomii (np. wpływ wykształcenia na dochód), naukach przyrodniczych (zależność między ciśnieniem a temperaturą), inżynierii (kalibracja sensorów), medycynie (związek dawki leku z efektem), marketingu (wpływ ceny i reklamy na sprzedaż) oraz przy prognozach i kontroli jakości. Typowe przykłady edukacyjne to dopasowanie wzrostu do wagi, przewidywanie cen nieruchomości na podstawie metrażu i lokalizacji, czy estymacja popytu w zależności od ceny.

Praktyczne kroki przy budowie modelu

- Zbadaj dane: brakujące wartości, outliery, rozkłady zmiennych.

- Wybierz kandydatów na predyktory i rozważ transformacje (logarytmy, pierwiastki, polinomy) jeśli zależność nie jest liniowa.

- Dopasuj model (np. OLS), oceń R², skorygowany R², testy istotności i kryteria informacyjne.

- Przeprowadź diagnostykę reszt i analizę wpływu obserwacji.

- W razie potrzeby zastosuj poprawki: robustne estymatory, regularizację, selekcję zmiennych, modele uogólnione lub metody nieliniowe.

- Waliduj model na danych niezależnych (cross-validation) i raportuj niepewność predykcji (przedziały ufności i prognozy).

Uwaga dotycząca interpretacji: regresja liniowa opisuje zależność statystyczną, ale nie dowodzi przyczynowości bez dodatkowych założeń lub eksperymentalnego projektu badania. Wyniki powinny być interpretowane ostrożnie, z uwzględnieniem możliwych zmiennych zakłócających i specyfiki danych.

Regresja liniowa pozostaje jednym z najbardziej czytelnych i użytecznych narzędzi analitycznych: jej prostota, łatwość interpretacji i szerokie spektrum rozszerzeń sprawiają, że jest często pierwszym wyborem przy modelowaniu zależności między zmiennymi.