W statystyce i teorii prawdopodobieństwa, korelacja opisuje stopień i kierunek zależności między dwoma zestawami danych lub zmiennych. Innymi słowy, mówi nam, jak bardzo wartości jednej zmiennej są powiązane z wartościami drugiej. Korelacja może dotyczyć związków liniowych lub nieliniowych i występuje zarówno w analizach eksploracyjnych, jak i w modelowaniu.

Rodzaje korelacji

- Korelacja dodatnia: gdy wartości obu zmiennych rosną razem — wzrost jednej zmiennej towarzyszy wzrostowi drugiej.

- Korelacja ujemna: gdy wzrost jednej zmiennej wiąże się ze spadkiem drugiej.

- Brak korelacji (korelacja zerowa): brak wyraźnego związku liniowego między zmiennymi — nie oznacza to jednak braku jakiejkolwiek zależności (może istnieć silna zależność nieliniowa).

Najczęściej stosowane miary korelacji

- Współczynnik korelacji Pearsona (r): mierzy siłę i kierunek zależności liniowej. Przyjmuje wartości od −1 do 1, gdzie 1 oznacza idealną korelację dodatnią, −1 idealną korelację ujemną, a 0 brak korelacji liniowej. Matematycznie r = cov(X,Y) / (σX σY), gdzie cov to kowariancja, a σX, σY odchylenia standardowe.

- Korelacja rang Spearmana (ρ): opiera się na rangach danych i mierzy monotoniczne (niekoniecznie liniowe) zależności. Jest mniej czuła na odstające wartości i rozkład danych niż Pearson.

- Korelacja Kendalla (τ): również działa na rangach i ocenia zgodność uporządkowań par obserwacji — często używana przy mniejszych próbach lub gdy dane mają wiele związań rangowych.

- Partialna korelacja: mierzy związek pomiędzy dwiema zmiennymi po kontrolowaniu wpływu jednej lub kilku zmiennych trzecich.

Interpretacja wyników

- Współczynnik korelacji interpretuje się zwykle jako miarę siły związku liniowego: im wartość bezwzględna bliższa 1, tym silniejszy związek liniowy. Przykładowe, często stosowane (orientacyjne) progi:

- 0–0.1: bardzo słaba lub brak korelacji

- 0.1–0.3: słaba korelacja

- 0.3–0.5: umiarkowana korelacja

- 0.5–0.7: silna korelacja

- 0.7–0.9: bardzo silna korelacja

- 0.9–1.0: niemal doskonała korelacja

- R^2 (współczynnik determinacji): w przypadku regresji liniowej R^2 = r^2 (dla jednej zmiennej objaśniającej) i informuje, jaka część zmienności zmiennej zależnej jest wyjaśniana przez zmienność zmiennej niezależnej.

- Wielkość próby ma znaczenie: przy bardzo dużych próbach nawet niewielkie wartości r mogą być statystycznie istotne, ale praktycznie nieistotne.

Testowanie istotności i przedziały ufności

- Istnieją testy statystyczne (np. test t dla współczynnika Pearsona) sprawdzające hipotezę zerową H0: r = 0. Wynik testu (p-value) informuje o istotności statystycznej korelacji.

- Zaleca się raportowanie nie tylko p-value, ale też wartości współczynnika, przedziału ufności dla współczynnika oraz rozmiaru próby.

Pułapki i ograniczenia

- Korelacja nie oznacza związku przyczynowego. Dwa zjawiska mogą korelować z powodu czynnika trzeciego (konfundera) lub przypadkowo. Przykład: sprzedaż lodów i liczba utonięć rosną razem latem — tu czynnikiem wspólnym jest temperatura.

- Wpływ odstających obserwacji (outliers): pojedyncze skrajne wartości mogą znacząco zmienić wartość współczynnika Pearsona.

- Brak wrażliwości na nieliniowość: Pearson mierzy zależność liniową — dla zależności nieliniowych jego wartość może być bliska zeru mimo silnego związku.

- Simpson’s paradox: uogólnienia na poziomie agregatów mogą prowadzić do sprzecznych wniosków w porównaniu z analizą podgrup.

Wizualizacja i praktyczne wskazówki

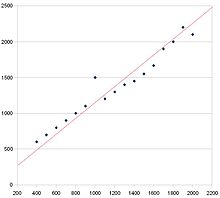

- Wykres rozrzutu (scatterplot): podstawowe narzędzie do oceny korelacji — często rysuje się na nim linię najlepszego dopasowania (regresji) lub krzywe dopasowania (np. LOESS) aby lepiej uwidocznić strukturę zależności.

- Macierz korelacji i heatmapy: przy wielu zmiennych warto użyć macierzy korelacji, która pokazuje pary współczynników oraz umożliwia szybką identyfikację silnych zależności.

- Kontrola zmiennych: rozważ użycie korelacji cząstkowych, regresji wielowymiarowej lub analiz przyczynowych, jeśli celem jest weryfikacja efektów po uwzględnieniu potencjalnych konfundujących czynników.

- Raportowanie wyników: podawaj metodę obliczenia (Pearson, Spearman, Kendall), wartość współczynnika, przedział ufności, p-value oraz liczbę obserwacji.

W praktyce dobór miary korelacji i interpretacja wyników zależą od rodzaju danych (ciągłe, porządkowe), rozkładu, obecności outlierów i celu analizy. Na wykresie rozrzutu ludzie często rysują linię najlepszego dopasowania, aby pokazać kierunek i charakter zależności, ale przed sformułowaniem wniosków warto rozważyć wszystkie powyższe ograniczenia i dodatkowe analizy.